На тэхналагічным рубяжы эвалюцыя штучнага інтэлекту (AI) працягвае стымуляваць незвычайныя інавацыі. Тым не менш, ён адначасова разгортвае апавяданне, прасякнутае асцярогамі наконт вымірання чалавецтва. Такія празорцы штучнага інтэлекту, як Сэм Альтман, кіраўнік OpenAI, і Джэфры Хінтан, агульнапрызнаны «хросным бацькам» штучнага інтэлекту, выразна сфармулявалі гэты страх.

Раскрываючы патэнцыйную катастрофу, адкрыты ліст ад Цэнтра бяспекі штучнага інтэлекту, падтрыманы больш чым 300 паважанымі падпісантамі, раскрыў пагрозу існаванню, якую ўяўляе штучны інтэлект. Аднак тое, як гэта створанае чалавекам цуд магло стаць прычынай гібелі чалавецтва, застаецца некалькі загадкавым.

ШІ пагражае знікненнем чалавека

Па словах Дэна Хендрыкса, дырэктара Цэнтра бяспекі штучнага інтэлекту, штучны інтэлект можа адкрыць мноства шляхоў для барацьбы з рызыкамі ў грамадскім маштабе. Адным з такіх сцэнарыяў з'яўляецца злоўжыванне ІІ зламыснымі суб'ектамі.

«Існуе вельмі распаўсюджанае памылковае меркаванне, нават у супольнасці штучнага інтэлекту, што думераў толькі некалькі. Але насамрэч многія людзі ў прыватным парадку выказваюць занепакоенасць гэтымі рэчамі», — сказаў Хендрыкс.

Уявіце сабе, што зламысныя сілы выкарыстоўваюць штучны інтэлект для стварэння біялагічнай зброі, смяротнасць якой пераўзыходзіць натуральныя пандэміі. Іншым прыкладам з'яўляецца запуск фальшывага штучнага інтэлекту з мэтай нанясення шырокай шкоды.

Калі сістэма штучнага інтэлекту надзелена дастатковым інтэлектам або магчымасцямі, яна можа нанесці хаос грамадству.

«Зламыснікі могуць наўмысна выпусціць жуліка ІІ, які актыўна спрабуе нанесці шкоду чалавецтву», — дадаў Хендрыкс.

Аднак гэта не толькі кароткачасовая пагроза, якая хвалюе экспертаў. Паколькі штучны інтэлект пранікае ў розныя аспекты эканомікі, адмова ад кантролю над тэхналогіямі патэнцыйна можа прывесці да доўгатэрміновых праблем.

Гэтая залежнасць ад штучнага інтэлекту можа зрабіць «іх выключэнне» разбуральным і, магчыма, недасяжным. Такім чынам, рызыкуючы чалавецтва ўзяць на сябе сваю будучыню.

Злоўжыванне і яго далёка ідучыя наступствы

Як папярэдзіў Сэм Альтман, здольнасць штучнага інтэлекту ствараць пераканаўчы тэкст, выявы і відэа можа прывесці да значных праблем. Сапраўды, ён лічыць, што «калі гэтая тэхналогія пойдзе не так, яна можа пайсці зусім не так».

Возьмем, да прыкладу, падроблены малюнак, які ілжыва паказвае моцны выбух каля Пентагона, які быў распаўсюджаны ў сацыяльных сетках. Гэта прывяло да часовага падзення фондавага рынку, паколькі многія акаўнты ў сацыяльных сетках, у тым ліку некалькі правераных, распаўсюдзілі падманную фатаграфію за лічаныя хвіліны, узмацніўшы бязладдзе.

Такое няправільнае выкарыстанне штучнага інтэлекту паказвае на патэнцыял тэхналогіі для распаўсюджвання дэзінфармацыі і парушэння грамадскай гармоніі. Старэйшы навуковы супрацоўнік Оксфардскага інстытута этыкі штучнага інтэлекту Элізабэт Рэньерыс сцвярджае, што штучны інтэлект можа «выклікаць экспанентны рост аб'ёму і распаўсюджвання дэзінфармацыі, тым самым разбіваючы рэальнасць і падрываючы давер грамадства».

Яшчэ адна трывожная тэндэнцыя - з'яўленне «галюцынацыйнага» ІІ. Гэта трывожная з'ява, калі ІІ выдае памылковую, але, здавалася б, праўдападобную інфармацыю.

Гэты недахоп, прадэманстраваны ў нядаўнім інцыдэнце з удзелам ChatGPT, можа паставіць пад сумнеў давер да кампаній, якія выкарыстоўваюць штучны інтэлект, і яшчэ больш паспрыяць распаўсюджванню дэзінфармацыі.

Эрозія працоўных месцаў і выбух няроўнасці

Хуткае прыняцце штучнага інтэлекту ў розных галінах прамысловасці кідае трывожны цень на рынак працы. Па меры развіцця тэхналогіі патэнцыйная ліквідацыя мільёнаў працоўных месцаў стала актуальнай праблемай.

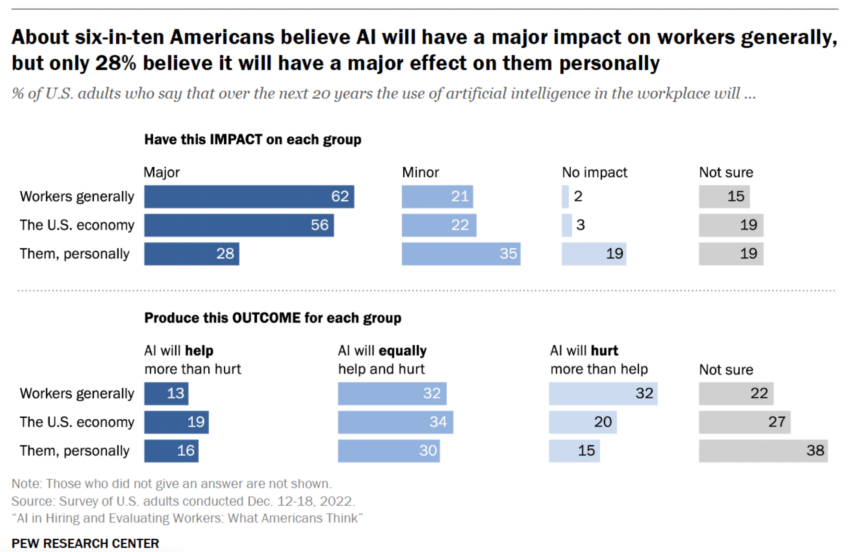

Апошняе агляд паказалі, што шэсць з дзесяці амерыканцаў лічаць, што выкарыстанне штучнага інтэлекту на працоўным месцы значна паўплывае на працоўных у бліжэйшыя 20 гадоў. Каля 28% рэспандэнтаў лічаць, што выкарыстанне гэтай тэхналогіі паўплывае на іх асабіста, а яшчэ 15% лічаць, што «ШІ больш нашкодзіць, чым дапаможа».

Усплёск аўтаматызаванага прыняцця рашэнняў можа спрыяць росту прадузятасці, дыскрымінацыі і адключэння. Гэта таксама можа спрыяць узнікненню асяроддзя няроўнасці, асабліва закранаючы тых, хто апынуўся па той бок лічбавага разрыву.

Больш за тое, пераход да залежнасці ад ІІ можа прывесці да «аслаблення» чалавецтва. Гэта можа быць падобна на антыўтапічны сцэнар у такіх фільмах, як Wall-E.

Цэнтр бяспекі штучнага інтэлекту адзначыў, што дамінаванне штучнага інтэлекту можа паступова патрапіць пад кантроль абмежаванай колькасці арганізацый. Гэта можа дазволіць «рэжымам навязваць вузкія каштоўнасці праз паўсюднае сачэнне і жорсткую цэнзуру».

Гэта змрочнае бачанне будучыні падкрэслівае патэнцыйныя рызыкі, звязаныя з ІІ, і падкрэслівае неабходнасць строгага рэгулявання і кантролю.

Заклік да рэгулявання штучнага інтэлекту

Сур'ёзнасць гэтых праблем прымусіла лідэраў галіны выступаць за больш жорсткія правілы ІІ. Гэты заклік да ўмяшання ўрада пераклікаецца з расце кансенсусам аб тым, што распрацоўкай і разгортваннем штучнага інтэлекту трэба старанна кіраваць, каб прадухіліць няправільнае выкарыстанне і ненаўмысны грамадскі разлад.

Штучны інтэлект можа стаць дабром або шкодай, у залежнасці ад таго, як з ім абыходзіцца. Вельмі важна спрыяць глабальнай размове аб зніжэнні рызык, адначасова карыстаючыся перавагамі гэтай магутнай тэхналогіі.

Прэм'ер-міністр Вялікабрытаніі Рышы Сунак сцвярджае, што штучны інтэлект адыграў важную ролю ў аказанні дапамогі асобам з паралічам хадзіць і раскрыцці новых антыбіётыкаў. Тым не менш, вельмі важна, каб гэтыя працэсы праводзіліся бяспечна і бяспечна.

«Людзі будуць занепакоеныя паведамленнямі аб тым, што ІІ стварае небяспеку для існавання, напрыклад, пандэміі або ядзерныя войны. Я хачу, каб яны былі запэўненыя ў тым, што ўрад вельмі ўважліва глядзіць на гэта», — сказаў Сунак.

Кіраванне штучным інтэлектам павінна стаць глабальным прыярытэтам, каб ён не стаў пагрозай існаванню чалавека. Каб выкарыстоўваць перавагі штучнага інтэлекту, адначасова зніжаючы рызыку знікнення чалавека, важна дзейнічаць асцярожна і пільна. Урады таксама павінны прыняць нарматыўныя акты, спрыяць глабальнаму супрацоўніцтву і інвеставаць у дбайныя даследаванні.

адмова

У адпаведнасці з рэкамендацыямі Trust Project у гэтым тэматычным артыкуле прадстаўлены меркаванні і пункты гледжання экспертаў галіны або прыватных асоб. BeInCrypto імкнецца да празрыстай справаздачнасці, але погляды, выказаныя ў гэтым артыкуле, неабавязкова адлюстроўваюць погляды BeInCrypto або яго супрацоўнікаў. Чытачы павінны правяраць інфармацыю самастойна і пракансультавацца са спецыялістам, перш чым прымаць рашэнні на аснове гэтага кантэнту.

Крыніца: https://beincrypto.com/artificial-intelligence-ai-risk-of-human-extinction/